- اظهارات معنادار ترامپ پیش از مذاکرات: ایران نمیخواهد بهای عدم توافق را بدهد

- تحرکات نظامی آمریکا در خاورمیانه / حضور نظامی تمدید شد

- دور دوم دیپلماسی در ژنو؛ سناریوهای پیشروی مذاکرات هستهای ایران و آمریکا

- شب مرگ و زندگی استقلال / آبیها حذف میشوند؟

- «نبرد عبرتآموز»: ایران چگونه معادلات جنگ را دگرگون کرده است؟

- فارس: سه نفتکش توقیف شده توسط هند ارتباطی با ایران ندارد

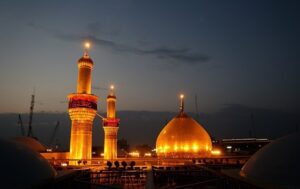

- ایران گنبد جدید حرم امام حسین (ع) را با طلا ساخت / طلاهای گنبد از کجا تأمین شد؟

- زمان ورود ناو آمریکایی به منطقه مشخص شد؟ / اعلام وضعیت فوق العاده

- آیا حماس خلع سلاح خواهد شد؟/ پاسخ رهبران حماس به آخرین مهلت خلع سلاح

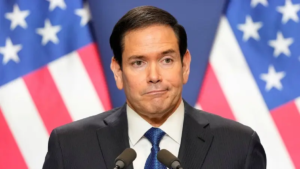

- اظهارات جدید وزیر امور خارجه آمریکا درمورد وضعیت مذاکرات با ایران

OpenAI دلیل توهم زدن هوش مصنوعی را کشف کرده و راهکاری برای رفع آن پیشنهاد داده است

شرکت OpenAI بهتازگی با انتشار یک مقاله دلایل پشت پرده توهمات هوش مصنوعی را کشف کرده برای رفع این مشکل مجموعهای از راهحلها را نیز پیشنهاد داده است.

چتباتهای هوش مصنوعی حالا در کلاسهای درس، محلهای کار و زندگی روزمره نقش فعالی دارند، اما این محصولات همچنان از یک نقص آزاردهنده رنج میبرند. این چتباتها گاهی مطالب نادرست میسازند، پدیدهای که به آن «توهم» گفته میشود این مدل نتایج ارائه شده توسط هوش مصنوعی میتوانند کاملاً قانعکننده به نظر برسند، اما در واقعیت کاملاً اشتباه هستند.

OpenAI میخواهد سیستمهای هوش مصنوعی بدون توهم بسازد

اما حالا شرکت OpenAI اعلام کرده که دریافته چرا این اتفاق رخ میدهد و معتقد است راهکاری پیدا کرده که میتواند ابزارهای هوش مصنوعی آینده را بسیار قابلاعتمادتر کند. این شرکت اخیراً مقالهای ۳۶ صفحهای منتشر کرده که با همکاری «سانتوش ومپالا» از دانشگاه جورجیا تک و چند پژوهشگر دیگر نوشته شده است و به بررسی مشکل توهم زدن هوش مصنوعی میپردازد.

به گفته محققان، توهمات لزوماً ناشی از طراحی ضعیف مدل نیستند، بلکه به نحوه آزمون و رتبهبندی سیستمهای هوش مصنوعی مربوط میشوند. براساس معیارهای فعلی، یک چتبات در صورت پاسخدادن به یک سؤال، حتی اگر به این سؤال پاسخ اشتباه بدهد، پاداش دریافت میکند. این درحالی است که این معیارها مدلهایی را که در صورت عدم اطمینان کافی به یک سؤال پاسخ نمیدهند را تنبیه میکنند.

محققان میگویند میتوان این موضوع را به یک امتحان چندگزینهای تشبیه کرد که دانشآموز را بهجای اینکه سؤال را بیپاسخ بگذارد به حدسزدن پاسخ تشویق میکند.

این مقاله برای مقابله با چنین مشکلی پیشنهاد میکند که سیستم امتیازدهی معکوس شود. یعنی پاسخهای «با اعتمادبهنفس اما اشتباه» باید بهشدت به ضرر مدل تمام شوند، درحالیکه برای احتیاط کردن یا اذعان به نداشتن قطعیت به مدل پاداش داده شود.

استفاده از این رویکرد ظاهراً کارساز نیز بوده است. در یک معیار ارزیابی، یک مدل محتاط تنها به نیمی از پرسشها پاسخ داد اما ۷۴ درصد آنها درست بود، درحالیکه مدل دیگری تقریباً به همه پرسشها پاسخ داد؛ اما در سه مورد از هر چهار بار دچار توهم شد.

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت

- تحول طراحی مدار الکترونیکی با هوش مصنوعی جدید در ۲۰۲۶

- نتیجه عجیب آزمایش شبیهسازی فروشندگی: ایجنت هوش مصنوعی Claude کارتل تشکیل داد

- ماجرای فشار «پنتاگون» به شرکتهای هوش مصنوعی چیست؟

- «چتجیپیتی» در هند ۱۰۰ میلیون کاربر هفتگی دارد

- جنجال بر سر پیشبینی درآمد از روی چهره!

- واکنش تند هالیوود به هوش مصنوعی بایتدنس؛ Seedance 2.0 متهم به سرقت هنری شد