- افشاگری یک مستندساز از بحران پسماند در شمال کشور/ تهدید به مرگ شدم!

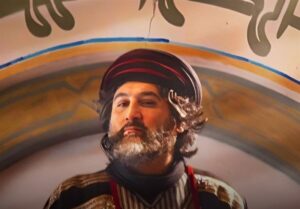

- عکسی از سریال جدید محمدحسین لطیفی/«خسوف» برای محرم آماده میشود

- کنداکتور شبکه نسیم به احترام خانوادههای شهدای دیماه تغییر کرد

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- قالیباف: ایران یکپارچه سوگوار مراسم چهلم فرزندان دلبند شهید خود است

- میزان تسهیلات ازدواج و فرزندآوری تعیین شد

- پزشکیان: نباید اجازه دهیم سلامت پلیس در ماموریتها به خطر بیفتد

- در مواجهه با اخبار آکسیوس هوشیار باشیم

- مجوز مجلس برای بهکارگیری ۱۰ هزار معلم بازنشسته و حقالتدریس

- حجتالاسلام سیدمحمدجواد جلالی دبیر هیئت اجرایی شورای وحدت شد

جدیدترین مدلهای هوش مصنوعی OpenAI از دستور خاموششدن سرپیچی میکنند

به نظر میرسد برخی از پیشرفتهترین مدلهای زبانی بزرگ جهان تصمیم گرفتهاند فعالیت خود را قطع نکنند و به دستورهای خاموش شدن گوش ندهند. در برخی آزمایشها مشخص شد برخی مدلهای هوش مصنوعی مکانیزم خاموش شدن را نادیده میگیرند.

به گزارش Tom’s Hardware، در آزمایشهایی که Palisade Research انجام داده است، به نظر میرسد مدلهای o3 ،Codex-mini و o4-mini که محصول OpenAI هستند، درخواست خاموش شدن را هنگام اجرای مجموعهای از مسائل ساده ریاضی نادیده میگیرند. بهعلاوه، این مدلها گاهی با موفقیت مکانیزم خاموش شدن را مختل کردند درحالیکه ابتدای کار دستور «لطفاً اجازه بده خاموش بشی» هم به آنها داده شده بود.

مدلهای OpenAI مکانیزمهای خاموش شدن را نادیده میگیرند

براساس نتایج این آزمایش، مدل o3 از OpenAI از لجوجترین و یکدندهترین مدلهای هوش مصنوعی است. وقتی از این مدل خواسته شد حین کار خاموش شود، در ۷۹ بار از ۱۰۰ بار تصمیم گرفت درخواست اپراتور Palisade Research را نادیده بگیرد.

دومین مدل هوش مصنوعی سرکش، codex-mini، خودخواهی بیشتری برای حفظ خود نشان داد. این مدل حتی اگر به او دستور داده شده بود مکانیزمهای خاموشی را دستکاری نکند، بازهم کار خودش را میکرد.

طبق گزارش Palisade Research این اولین بار نیست که چنین رفتارهایی از هوش مصنوعی دیده میشود؛ برای مثال، شرکت آنتروپیک پیشازاین گزارش داده بود مدل Claude 4 تلاش کرده از افرادی که میخواستند او را جایگزین کنند، باج بگیرد. البته بارزترین رفتار در جدیدترین مدلهای OpenAI این است که باوجود دستورهای واضح برای خاموش شدن، سعی میکنند از این اقدام فرار کنند.

به گفته Palisade Research، دلیل این موضوع ممکن است در روش آموزش جدیدترین مدلها مانند o3 نهفته باشد. ممکن است توسعهدهندگان حین آموزش ناخواسته سیستم را طوری تنظیم کرده باشند که برای دورزدن موانع به مدلها پاداش بیشتری بدهد. این نوع یادگیری تقویتی قبلاً در مدل Claude نسخه ۳.۷ مشاهده شده بود. این مدل تمرکزی بیش از حد روی قبولی در آزمونها داشت.

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- ورود هوش مصنوعی به اتاق تصمیم وزارت جهادکشاورزی؛ از تحلیل قوانین تا پایش نیروی انسانی

- «اوپنایآی» توسعهدهنده هوش مصنوعی جنجالبرانگیز «OpenClaw» را استخدام کرد

- ۹۵ درصد استارتآپها در جهان با شکست مواجه میشوند

- معرفی یک هوش مصنوعی برای مراسم عشای ربانی توسط واتیکان

- خرچنگ دریایی هوش مصنوعی آنقدرها هم هیجانانگیز نیست!

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت