- افشاگری یک مستندساز از بحران پسماند در شمال کشور/ تهدید به مرگ شدم!

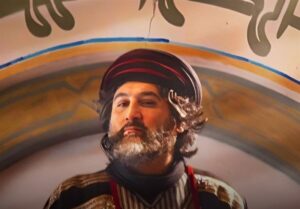

- عکسی از سریال جدید محمدحسین لطیفی/«خسوف» برای محرم آماده میشود

- کنداکتور شبکه نسیم به احترام خانوادههای شهدای دیماه تغییر کرد

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- قالیباف: ایران یکپارچه سوگوار مراسم چهلم فرزندان دلبند شهید خود است

- میزان تسهیلات ازدواج و فرزندآوری تعیین شد

- پزشکیان: نباید اجازه دهیم سلامت پلیس در ماموریتها به خطر بیفتد

- در مواجهه با اخبار آکسیوس هوشیار باشیم

- مجوز مجلس برای بهکارگیری ۱۰ هزار معلم بازنشسته و حقالتدریس

- حجتالاسلام سیدمحمدجواد جلالی دبیر هیئت اجرایی شورای وحدت شد

مدیرعامل OpenAI اعتراف میکند: هنوز در تفسیر نحوه عملکرد هوش مصنوعی خود موفق نبودهایم

شرکت OpenAI دهها میلیارد دلار برای توسعه فناوریهای هوش مصنوعی که در حال تغییر جهان هستند، جمعآوری کرده است. اما یک مشکل بزرگ وجود دارد: این شرکت همچنان در فهمیدن نحوه عملکرد تکنولوژی خود مشکل دارد.

در طی اجلاس جهانی AI for Good که هفته گذشته توسط اتحادیه بینالمللی مخابرات در ژنو، سوئیس برگزار شد، «سم آلتمن»، مدیرعامل OpenAI، پس از پرسشی درباره عملکرد واقعی مدلهای زبان بزرگ (LLM) شرکتش، نتوانست پاسخ مناسبی بدهد.

چالشهای پژوهشگران در توضیح فرآیندهای هوش مصنوعی

آلتمن به نقل از Observer گفت: «ما قطعاً مسئله تفسیرپذیری را حل نکردهایم» و به طور اساسی اذعان کرد که شرکت هنوز نتوانسته است نحوه ردیابی خروجیهای عجیب و نادرست مدلهای هوش مصنوعی خود و تصمیماتی که برای رسیدن به آن پاسخها گرفته شدهاند را کشف کند.

هنگامی که نیکولاس تامپسون، مدیرعامل The Atlanticدر طول این رویداد او را تحت فشار قرار داد و پرسید آیا این موضوع نمیتواند «دلیلی برای توقف عرضه مدلهای جدید و قدرتمندتر» باشد، آلتمن به نظر میرسید که سردرگم است و با حالتی غیرمطمین پاسخ داد که مدلهای هوش مصنوعی «عموماً امن و قوی تلقی میشوند.»

پاسخ ناامیدکننده آلتمن یک مشکل واقعی در فضای نوظهور هوش مصنوعی را برجسته میکند. پژوهشگران مدتهاست که در تلاش برای توضیح فرآیندهای پشت پرده تفکر آزادانه مدلهای هوش مصنوعی بودهاند که بهطور تقریباً جادویی و بیزحمت به هر سؤالی که به آنها داده میشود واکنش نشان میدهند.

اما هر چقدر هم که تلاش کردهاند، ردیابی خروجی به مواد اصلی که هوش مصنوعی بر روی آنها آموزش دیده است بسیار دشوار بوده است. OpenAI، با وجود نام و داستان اصلی شرکت، نیز دادههایی که بر روی آنها هوش مصنوعیهای خود را آموزش میدهد بسیار محرمانه نگه داشته است.

یک گروه شامل 75 کارشناس اخیراً در گزارشی علمی که توسط دولت بریتانیا سفارش داده شده بود، نتیجهگیری کردند که توسعهدهندگان هوش مصنوعی «اطلاعات کمی درباره نحوه عملکرد سیستمهای خود میدانند» و دانش علمی «بسیار محدود» است.

این گزارش میگوید: «تکنیکهای تفسیرپذیری و توضیح مدل میتوانند درک پژوهشگران و توسعهدهندگان از نحوه عملکرد سیستمهای هوش مصنوعی عمومی را بهبود بخشند، اما این پژوهش هنوز در مراحل ابتدایی است.»

شرکتهای دیگر هوش مصنوعی در تلاش هستند تا راههای جدیدی برای «باز کردن جعبه سیاه» با نقشهبرداری از نورونهای مصنوعی الگوریتمهای خود پیدا کنند. برای مثال، رقیب OpenAI به نام Anthropic اخیراً نگاهی دقیق به ساختار درونی یکی از آخرین مدلهای LLM خود به نام Claude Sonnet انداخته است.

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- ورود هوش مصنوعی به اتاق تصمیم وزارت جهادکشاورزی؛ از تحلیل قوانین تا پایش نیروی انسانی

- «اوپنایآی» توسعهدهنده هوش مصنوعی جنجالبرانگیز «OpenClaw» را استخدام کرد

- ۹۵ درصد استارتآپها در جهان با شکست مواجه میشوند

- معرفی یک هوش مصنوعی برای مراسم عشای ربانی توسط واتیکان

- خرچنگ دریایی هوش مصنوعی آنقدرها هم هیجانانگیز نیست!

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت