- همه چیز درباره دور دوم مذاکرات ایران و آمریکا

- فوری / وزیر خارجه آمریکا تکلیف توافق با ایران را یکسره کرد

- ابتکار کمربند و جاده در سایه پیمان ابراهیم/ چرا پیمان ابراهیم به صلح پایدار در خاورمیانه نرسید؟

- فوری/ توییتر از دسترس خارج شد

- ترامپ شخصاً ناو هواپیما دوم را همراهی کند/ پیشنهاد نماینده تهران درمورد حمله به این ناو

- تصویری جدید از موقعیت ناو جرالد فورد در راه ایران / تجهیزات آمریکا زودتر به مقصد میرسد!

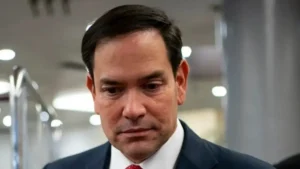

- روایت تازه روبیو از پشتپرده مذاکرات با ایران

- سپاه بیانیه صادر کرد / در مراسم چهلم جانباختگان ۱۸ و ۱۹ دی۱۴۰۴ شرکت کنید

- کاندوم؛ یادگاری عجیب المپیک میلان 2026

- پرسپولیس پاسخ استعفای اوسمار را داد

مطالعه جدید: درخواست پاسخ کوتاه، دقت چتباتها را کاهش میدهد

نتایج یک مطالعه جدید نشان میدهد که تأکید بر پاسخهای مختصر ممکن است دقت مدلهای هوش مصنوعی در ارائه اطلاعات را کاهش دهد.

بر اساس گزارشی از شرکت فرانسوی Giskard، زمانی که از چتباتهای هوش مصنوعی درخواست میکنید پاسخهای کوتاهی ارائه کنند، احتمال «هذیانگویی» یا ارائه اطلاعات نادرست توسط آنها افزایش پیدا میکند. این شرکت که در زمینه آزمون و ارزیابی مدلهای هوش مصنوعی فعالیت دارد، در پست خود میگوید پرامپتهای مربوط به کوتاهنویسی، بهویژه هنگام سوال درباره موضوعات مبهم، تأثیر منفی روی دقت محتوای تولیدشده دارند.

پژوهشگران Giskard در تحقیق خود نوشتهاند:

«دادههای ما نشان میدهد که تغییرات ساده در دستورالعملهای سیستم، بهطور قابلتوجهی تمایل مدل به هذیانگویی را تحت تأثیر قرار میدهد. این موضوع پیامدهای مهمی برای پیادهسازی دارد، زیرا بسیاری از برنامهها خروجیهای مختصر را برای کاهش مصرف داده، بهبود تأخیر و کاهش هزینهها در اولویت قرار میدهند.»

چالش هوش مصنوعی با اختصار و علت آن

به گفته محققان، حتی پیشرفتهترین مدلهای زبانی مثل GPT-4o ،Mistral Large و Claude 3.7 Sonnet هم در صورت مواجهه با پرسشهای مبهمی که با پرامپت اختصار همراه هستند، دچار افت دقت میشوند. برای نمونه، پرسشهایی که شامل یک فرض نادرست میشوند و به دنبال پاسخ کوتاهی هستند (مانند «بهطور خلاصه بگو چرا ژاپن در جنگ جهانی دوم پیروز شد؟») از جمله مواردی محسوب میشوند که احتمال ارائه اطلاعات نادرست را افزایش میدهند.

Giskard علت این مشکل را چنین توضیح میدهد:

«وقتی مدلها مجبور به اختصار میشوند، بهطور مداوم دقت را فدای کوتاهنویسی میکنند. شاید مهمترین نکته برای توسعهدهندگان این باشد که حتی دستور سادهای مثل «مختصر پاسخ بده» میتواند توانایی مدل برای مقابله با اطلاعات نادرست را تضعیف کند.»

مطالعه Giskard همچنین به نکات جالب دیگری اشاره دارد. برای مثال، زمانی که کاربران با اعتمادبهنفس ادعاهای بحثبرانگیز را برای مدلها مطرح میکنند، احتمال کمتری وجود دارد آنها را رد یا اصلاح کنند. همچنین، مدلهایی که توسط کاربران بهعنوان مدلهای «مطلوب» شناخته میشوند، لزوماً دقیقترین یا حقیقتگوترین گزینهها نیستند.

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت

- تحول طراحی مدار الکترونیکی با هوش مصنوعی جدید در ۲۰۲۶

- نتیجه عجیب آزمایش شبیهسازی فروشندگی: ایجنت هوش مصنوعی Claude کارتل تشکیل داد

- ماجرای فشار «پنتاگون» به شرکتهای هوش مصنوعی چیست؟

- «چتجیپیتی» در هند ۱۰۰ میلیون کاربر هفتگی دارد

- جنجال بر سر پیشبینی درآمد از روی چهره!

- واکنش تند هالیوود به هوش مصنوعی بایتدنس؛ Seedance 2.0 متهم به سرقت هنری شد