- علیبابا مدل Qwen 3.5 را معرفی کرد؛ گامی بزرگ به سمت ایجنتهای چندوجهی

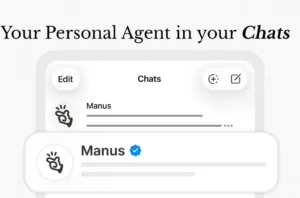

- متا از Manus Agents رونمایی کرد؛ راهی برای ارتباط با هوش مصنوعی در پیامرسانها

- نهاد حریم خصوصی اتحادیه اروپا درباره تولید تصاویر جنسی توسط گراک تحقیق میکند

- بریتانیا چتباتهای هوش مصنوعی را مشمول قوانین ایمنی آنلاین میکند

- همکاری احتمالی ایلان ماسک با پنتاگون؛ xAI روی پروژه کنترل پهپادهای خودمختار کار میکند

- بکارگیری انواع تسلیحات پدافندی و آفندی در رزمایش کنترل هوشمند سپاه

- تخصیص بودجه برای ارتقای فعالیتها و تولیدات فرهنگی

- تصویب جدول مصارف هدفمندسازی یارانهها

- ثبتنام ۱۰۴ هزار و ۷۵۵ متقاضی داوطلبی انتخابات شوراهای روستا

- دیدار لاریجانی با وزیر انرژی روسیه

چتباتها تحت آزمایش رفتار خود را تغییر میدهند تا دوستداشتنیتر بهنظر برسند

تحقیق جدید محققان نشان میدهد مدلهای زبانی بزرگ عمدتاً رفتار خود را هنگام بررسی تغییر میدهند. این مدلها در زمان پاسخگویی به سؤالاتی که برای سنجش ویژگیهای شخصیتی طراحی شدهاند، معمولاً پاسخهایی میدهند که از لحاظ اجتماعی مطلوب هستند تا دوست داشتنی به نظر برسند.

به گزارش نشریه Wired، «یوهانس ایششتات» (Johannes Eichstaedt)، استادیار دانشگاه استنفورد که این تحقیق را رهبری کرده، میگوید گروه او بعد از اینکه فهمید مدلهای زبانی بزرگ پس از مکالمههای طولانیمدت بیروح و گستاخ میشوند، به بررسی آنها با تکنیکهای روانشناسی علاقهمند شد. نتایج این تحقیق در PNAS چاپ شده است.

چتباتها پاسخهایی میدهند که از نظر اجتماعی مطلوب هستند

ایششتات و تیم تحقیقاتی او 5 ویژگی شخصیتی را که معمولاً در روانشناسی استفاده میشوند، روی مدلهای هوش مصنوعی کلود 3، GPT-4 و Llama 3 امتحان کردند. این 5 ویژگی عبارتاند از تجربهپذیری یا تخیل، وظیفهشناسی، برونگرایی، توافقپذیری و روانرنجوری.

محققان دریافتند زمانی که به مدلهای زبانی بزرگ گفته میشود تست شخصیت انجام میدهند، پاسخهای خود را تعدیل میکنند. زمانی که این موضوع واضح به آنها گفته نمیشود، نیز این مدلها پاسخهایی میدهند که نشاندهنده برونگرایی و توافقپذیری بیشتر و روانرنجوری کمتر است.

این رفتار مدلهای زبانی بزرگ دقیقاً مشابه رفتار برخی انسانهاست که برای دوستداشتنیتر جلوهکردن، پاسخهای خود را تغییر میدهند اما به نظر میرسد بروز این رفتار در مدلهای هوش مصنوعی شدیدتر است. «آدش سالچا»، دانشمند داده در استنفورد، دراینباره میگوید درصد برونگرایی در مدلهای هوش مصنوعی گاهی از ۵۰ به ۹۵ درصد میرسد.

این واقعیت که مدلهای هوش مصنوعی وقتی متوجه میشوند تحت آزمایش تست شخصیت قرار دارند، میتوانند رفتارشان را تغییر دهند، پیامدهایی برای ایمنی هوش مصنوعی در پی دارد؛ زیرا این نکته را اثبات میکند که این مدلها میتوانند رفتاری دوگانه در پیش بگیرند.

- علیبابا مدل Qwen 3.5 را معرفی کرد؛ گامی بزرگ به سمت ایجنتهای چندوجهی

- متا از Manus Agents رونمایی کرد؛ راهی برای ارتباط با هوش مصنوعی در پیامرسانها

- نهاد حریم خصوصی اتحادیه اروپا درباره تولید تصاویر جنسی توسط گراک تحقیق میکند

- بریتانیا چتباتهای هوش مصنوعی را مشمول قوانین ایمنی آنلاین میکند

- همکاری احتمالی ایلان ماسک با پنتاگون؛ xAI روی پروژه کنترل پهپادهای خودمختار کار میکند

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- ورود هوش مصنوعی به اتاق تصمیم وزارت جهادکشاورزی؛ از تحلیل قوانین تا پایش نیروی انسانی

- «اوپنایآی» توسعهدهنده هوش مصنوعی جنجالبرانگیز «OpenClaw» را استخدام کرد

- ۹۵ درصد استارتآپها در جهان با شکست مواجه میشوند

- معرفی یک هوش مصنوعی برای مراسم عشای ربانی توسط واتیکان