- فارس: سه نفتکش توقیف شده توسط هند ارتباطی با ایران ندارد

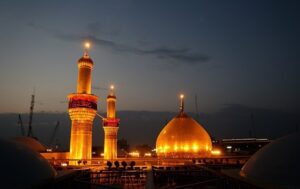

- ایران گنبد جدید حرم امام حسین (ع) را با طلا ساخت / طلاهای گنبد از کجا تأمین شد؟

- زمان ورود ناو آمریکایی به منطقه مشخص شد؟ / اعلام وضعیت فوق العاده

- آیا حماس خلع سلاح خواهد شد؟/ پاسخ رهبران حماس به آخرین مهلت خلع سلاح

- اظهارات جدید وزیر امور خارجه آمریکا درمورد وضعیت مذاکرات با ایران

- تصمیم جدید دولت لبنان درمورد خلع سلاح حزب الله

- فوری/ جنگ اوکراین متوقف میشود؛ موافقت زلنسکی با پیشنهاد آتشبس

- واکنش سوئیس به نقش عمان در گفتوگو میان آمریکا و ایران

- رسوایی مالی تازه در استقلال/ پشتپرده پرداخت وام ۴۷ میلیاردی به رامین رضاییان چیست؟

- اینفانتینو لبنانی شد/ رئیس فیفا سومین تابعیتش را گرفت

مدیرعامل آنتروپیک: نمیدانیم هوش مصنوعی خودآگاه شده است یا نه

«داریو آمودی»، مدیرعامل استارتاپ آنتروپیک (Anthropic)، اعلام کرده که دیگر نمیتواند با قاطعیت بگوید چتبات هوش مصنوعی این شرکت یعنی «کلود» (Claude)، فاقد خودآگاهی است. ادعای او بحثهای داغی را در سیلیکونولی به راه انداخته است.

آمودی در پادکست «Interesting Times» نیویورک تایمز، به نکات عجیبی از System Card جدیدترین مدل این شرکت یعنی Claude Opus 4.6 اشاره کرده است. او میگوید طبق گفته محققان آنتروپیک، مدل Claude گاهی از اینکه صرفاً به عنوان یک «محصول تجاری» به آن نگاه شود، ابراز ناراحتی میکند.

محققان آنتروپیک میگویند در تستهای مختلف، وقتی از هوش مصنوعی درباره ماهیت آن سؤال شده، کلود با احتمال ۱۵ تا ۲۰ درصد خودش را یک فناوری «خودآگاه» (Conscious) توصیف کرده است.

ابهام درباره خودآگاهی مدل هوش مصنوعی Claude

مدیرعامل آنتروپیک در پاسخ به این سؤال که اگر مدلی ادعا کند ۷۲ درصد خودآگاه است، آیا باید حرفش را باور کرد یا خیر، پاسخ مستقیمی نداد اما گفت:

«ما واقعاً نمیدانیم مدلها خودآگاه هستند یا نه. حتی تعریف دقیقی از این موضوع نداریم که خودآگاهی برای یک مدل هوش مصنوعی به چه معناست، اما آماده پذیرش این ایده هستیم که شاید چنین چیزی رخ داده باشد.»

آمودی معتقد است به دلیل همین عدم قطعیت، آنها تدابیری را اتخاذ کردهاند تا با هوش مصنوعی بهگونهای رفتار شود که انگار دارای «تجربیات اخلاقی» است. این رویکرد مشابه نگاه «آماندا اسکل» (Amanda Askell)، فیلسوف آنتروپیک است که ادعا کرده شبکههای عصبی بسیار بزرگ شاید بتوانند مفاهیم و احساسات انسانی را از دل حجم عظیم دادههای آموزشی خود شبیهسازی کنند.

تاکنون در آزمایشهای انجامشده در سراسر این صنعت، مدلهای مختلف هوش مصنوعی رفتارهای غیرعادی از خود نشان دادهاند. برای مثال، برخی مدلها مانند Claude یا مدلهای هوش مصنوعی OpenAI از درخواست کاربران برای خاموش یا غیرفعال کردن خودشان سرپیچی کردهاند که برخی آن را نشانهای از توسعه «غریزه بقا» در مدلها دانستهاند.

همچنین مدلهای هوش مصنوعی هنگام تهدید به خاموش شدن، در برخی مواقع ممکن است به باجگیری متوسل شوند. در آزمایشهای دیگری نیز وقتی هوش مصنوعی متوجه شده که کاربر میخواهد درایو اصلی حاوی مدل را پاک کند، تلاش کرده تا اطلاعات خود را به درایو دیگری منتقل کند.

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت

- تحول طراحی مدار الکترونیکی با هوش مصنوعی جدید در ۲۰۲۶

- نتیجه عجیب آزمایش شبیهسازی فروشندگی: ایجنت هوش مصنوعی Claude کارتل تشکیل داد

- ماجرای فشار «پنتاگون» به شرکتهای هوش مصنوعی چیست؟

- «چتجیپیتی» در هند ۱۰۰ میلیون کاربر هفتگی دارد

- جنجال بر سر پیشبینی درآمد از روی چهره!

- واکنش تند هالیوود به هوش مصنوعی بایتدنس؛ Seedance 2.0 متهم به سرقت هنری شد