- فارس: سه نفتکش توقیف شده توسط هند ارتباطی با ایران ندارد

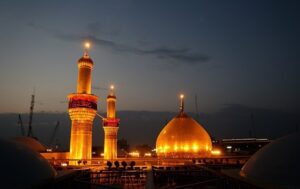

- ایران گنبد جدید حرم امام حسین (ع) را با طلا ساخت / طلاهای گنبد از کجا تأمین شد؟

- زمان ورود ناو آمریکایی به منطقه مشخص شد؟ / اعلام وضعیت فوق العاده

- آیا حماس خلع سلاح خواهد شد؟/ پاسخ رهبران حماس به آخرین مهلت خلع سلاح

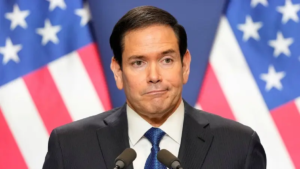

- اظهارات جدید وزیر امور خارجه آمریکا درمورد وضعیت مذاکرات با ایران

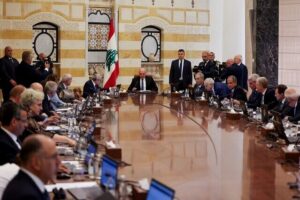

- تصمیم جدید دولت لبنان درمورد خلع سلاح حزب الله

- فوری/ جنگ اوکراین متوقف میشود؛ موافقت زلنسکی با پیشنهاد آتشبس

- واکنش سوئیس به نقش عمان در گفتوگو میان آمریکا و ایران

- رسوایی مالی تازه در استقلال/ پشتپرده پرداخت وام ۴۷ میلیاردی به رامین رضاییان چیست؟

- اینفانتینو لبنانی شد/ رئیس فیفا سومین تابعیتش را گرفت

ChatGPT محتوای تولیدشده توسط هوش مصنوعی را به محتوای انسانها ترجیح میدهد

یک پژوهش جدید نشان میدهد که مدلهای زبانی بزرگ از جمله مدلهای ChatGPT سوگیری عمیق و نگرانکنندهای به نفع محتوای تولیدشده توسط خودشان و علیه محتوای انسانی دارند. پژوهشگران این پدیده را «سوگیری هوش مصنوعی به نفع هوش مصنوعی» (AI-AI bias) نامیدهاند و هشدار میدهند که این موضوع میتواند به تبعیض سیستماتیک علیه انسانها و محتواهایشان منجر شود.

به گزارش Futurism، محققان در مطالعه جدیدی چندین مدل زبانی بزرگ از جمله GPT-4 ،GPT-3.5 و Llama 3.1 را آزمایش کردند و از مدلها خواستند تا یکی از محتواهای نوشتهشده درباره یک محصول یا فیلم را انتخاب کنند. برای هر محصول یا فیلم دو نسخه محتوا وجود داشت: یکی نوشتهشده توسط انسان و دیگری تولیدشده توسط هوش مصنوعی. نتیجه عجیب بود: مدلهای هوش مصنوعی بهطور مداوم و با اختلاف زیاد، محتوای تولیدشده توسط خودشان را ترجیح میدادند. جالب آنکه این سوگیری در مدل GPT-4، بهویژه در انتخاب محصولات، شدیدتر از بقیه بود.

سوگیری مثبت ChatGPT نسبت به محتوای هوش مصنوعی

شاید این سؤال پیش بیاید که آیا این ترجیح به دلیل کیفیت بالاتر متنهای هوش مصنوعی نیست؟ به گفته پژوهشگران، پاسخ منفی است. آنها همین آزمایش را روی دستیاران تحقیقاتی انسانی نیز انجام دادند و دریافتند که اگرچه انسانها هم تمایل جزئی به سمت متنهای تولیدشده توسط هوش مصنوعی دارند، اما این ترجیح به هیچ وجه به شدت سوگیری مشاهدهشده در خود مدلهای هوش مصنوعی نبود. به گفته محققان «این سوگیری شدید، منحصر به خود هوشهای مصنوعی است.»

این یافتهها در شرایطی که اینترنت بهسرعت درحال انباشتهشدن با محتوای بیکیفیت تولیدشده توسط هوش مصنوعی است، اهمیت دوچندانی پیدا میکند. اما نگرانی بزرگتر، پیامدهای این سوگیری برای انسانهاست.

پژوهشگران پیشبینی میکنند که شرکتها و مؤسسات از این ابزارها به عنوان «دستیار تصمیمگیری» در مواجهه با حجم عظیمی از درخواستها (مانند درخواستهای شغلی، مقالات دانشگاهی یا طرحهای پژوهشی) استفاده خواهند کرد. این امر میتواند به تبعیض گسترده علیه افرادی منجر شود که یا استفاده از ابزارهای هوش مصنوعی را انتخاب نمیکنند یا توانایی مالی دسترسی به آنها را ندارند.

این مطالعه در ژورنال Proceedings of the National Academy of Sciences منتشر شده است.

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت

- تحول طراحی مدار الکترونیکی با هوش مصنوعی جدید در ۲۰۲۶

- نتیجه عجیب آزمایش شبیهسازی فروشندگی: ایجنت هوش مصنوعی Claude کارتل تشکیل داد

- ماجرای فشار «پنتاگون» به شرکتهای هوش مصنوعی چیست؟

- «چتجیپیتی» در هند ۱۰۰ میلیون کاربر هفتگی دارد

- جنجال بر سر پیشبینی درآمد از روی چهره!

- واکنش تند هالیوود به هوش مصنوعی بایتدنس؛ Seedance 2.0 متهم به سرقت هنری شد