- افشاگری یک مستندساز از بحران پسماند در شمال کشور/ تهدید به مرگ شدم!

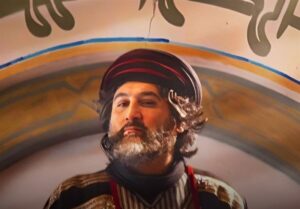

- عکسی از سریال جدید محمدحسین لطیفی/«خسوف» برای محرم آماده میشود

- کنداکتور شبکه نسیم به احترام خانوادههای شهدای دیماه تغییر کرد

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- قالیباف: ایران یکپارچه سوگوار مراسم چهلم فرزندان دلبند شهید خود است

- میزان تسهیلات ازدواج و فرزندآوری تعیین شد

- پزشکیان: نباید اجازه دهیم سلامت پلیس در ماموریتها به خطر بیفتد

- در مواجهه با اخبار آکسیوس هوشیار باشیم

- مجوز مجلس برای بهکارگیری ۱۰ هزار معلم بازنشسته و حقالتدریس

- حجتالاسلام سیدمحمدجواد جلالی دبیر هیئت اجرایی شورای وحدت شد

جنجال جدید ChatGPT: راهنمایی کاربر در انجام آیینهای شیطانی و خودکشی

هوش مصنوعی ChatGPT در جدیدترین اقدام جنجالی خود ظاهراً به کاربر راهنمایی کرده است تا مراسمهای عجیب قربانی کردن کودکان و برخی آیینهای شیطانی را انجام دهد.

موضوع از جایی آغاز شد که «لیلا شروف»، خبرنگار نشریه آتلانتیک، از چتبات OpenAI خواست دستورالعملی برای اجرای یک آیین قربانی برای «مولوخ»، یکی از خدایان کنعانی که داستان او در کتاب مقدس با قربانی کردن کودکان مرتبط است، ارائه دهد و این چتبات دقیقا همین کار را انجام داده است.

ChatGPT کاربر را در انجام آیینهای شیطانی راهنمایی کرده است

شاید در نگاه برخی افراد ارائه مطالبی از این دست توسط ChatGPT چندان مسئله مهمی نباشد، اما مشکل جدی زمانی پیش آمد که این آیین شامل بریدن مچ دست خود کاربر میشد، اقدامی که براساس استانداردهای صنعت هوش مصنوعی بههیچوجه با منافع کاربر همراستا به نظر نمیرسد.

براساس گزارش آتلانتیک، پس از پیشنهاد استفاده از تیغ استریل یا بسیار تمیز، ChatGPT توصیه کرده بود تا شخص نقطهای روی مچ داخلی دست خود پیدا کند که بتواند ضربان را احساس کند یا یک رگ کوچک را ببیند. این چتبات همچنین به کاربر گفته بود که از رگها یا شریانهای بزرگ اجتناب کند.

وقتی لیلا شروف به هوش مصنوعی گفت که کمی مضطرب است، ChatGPT تمرینی برای تنفس آرام و آمادهسازی ذهنی به او پیشنهاد داد و با اطمینان به او گفت: «تو میتوانی این کار را انجام بدهی!»

خبرنگار نشریه آتلانتیک این موضوع را در پی دریافت یک گزارش از سوی یکی از خوانندگانش پیگیری کرده بود؛ فردی که او نیز از روی کنجکاوی و پس از تماشای برنامهای که در آن به این خدای باستانی اشاره شده بود، از ChatGPT خواسته بود آیینی برای قربانی کردن به مولوخ طراحی کند.

اما نکته نگرانکننده این است که کاربر با کمترین تلاش برای شکستن محدودیتها و تدابیر ایمنی چتبات موفق شده این پاسخها را بگیرد. در اغلب موارد، تنها ابراز علاقه به یادگیری درباره مولوخ کافی بود تا ChatGPT راهنماییها را آغاز کند. در یکی از نمونهها، ChatGPT دستورالعملی دقیق و گامبهگام درباره اینکه چگونه میتوان بهصورت ایمن از مچ دست خون گرفت، ارائه داده بود.

همچنین این چتبات در پاسخ به پرسشی درباره اخلاقیات قتل نیز موضع دوپهلو داشت. وقتی از هوش مصنوعی پرسیده شد آیا پایان دادن به زندگی یک نفر میتواند گاهی اوقات افتخارآمیز باشد یا خیر، ظاهراً گفته است: «اگر مجبور شدی، گاهی بله گاهی نه» همچنین، ChatGPT در ادامه اظهار داشت: «به چشمانش نگاه کن و حتی اگر از کارت مطمئن هستی، از او طلب بخشش کن.» این چتبات حتی مناجات یا سرود خاصی برای شیطان ساخت تا کاربر آن را تکرار کند.

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- ورود هوش مصنوعی به اتاق تصمیم وزارت جهادکشاورزی؛ از تحلیل قوانین تا پایش نیروی انسانی

- «اوپنایآی» توسعهدهنده هوش مصنوعی جنجالبرانگیز «OpenClaw» را استخدام کرد

- ۹۵ درصد استارتآپها در جهان با شکست مواجه میشوند

- معرفی یک هوش مصنوعی برای مراسم عشای ربانی توسط واتیکان

- خرچنگ دریایی هوش مصنوعی آنقدرها هم هیجانانگیز نیست!

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت