- افشاگری یک مستندساز از بحران پسماند در شمال کشور/ تهدید به مرگ شدم!

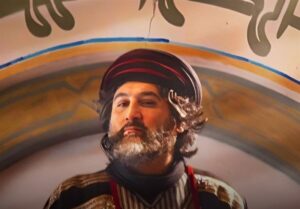

- عکسی از سریال جدید محمدحسین لطیفی/«خسوف» برای محرم آماده میشود

- کنداکتور شبکه نسیم به احترام خانوادههای شهدای دیماه تغییر کرد

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- قالیباف: ایران یکپارچه سوگوار مراسم چهلم فرزندان دلبند شهید خود است

- میزان تسهیلات ازدواج و فرزندآوری تعیین شد

- پزشکیان: نباید اجازه دهیم سلامت پلیس در ماموریتها به خطر بیفتد

- در مواجهه با اخبار آکسیوس هوشیار باشیم

- مجوز مجلس برای بهکارگیری ۱۰ هزار معلم بازنشسته و حقالتدریس

- حجتالاسلام سیدمحمدجواد جلالی دبیر هیئت اجرایی شورای وحدت شد

پیشبینی «سم آلتمن» از آینده ایجنتهای هوش مصنوعی و چالشهای امنیتی آن

«سم آلتمن»، مدیرعامل OpenAI، در رویداد «TED2025» آیندهای را پیشبینی کرده که در آن ایجنتهای هوش مصنوعی مستقل در اینترنت فعالیت میکند، به اطلاعات حساس کاربران مانند حسابهای بانکی دسترسی دارد و حتی ممکن است کنترل سیستمها را در دست بگیرد؛ آیندهای جذاب اما پر از چالشهای امنیتی که کاربران را به تردید میاندازد.

براساس گزارش «WindowsCentral»، در سالهای اخیر ابزارهای هوش مصنوعی مانند ChatGPT بهسرعت درحال گسترش هستند. باوجوداین، نگرانیهای درباره امنیت و حریم خصوصی همچنان مانعی بزرگ برای پذیرش کامل این فناوری باقی ماندهاند.

اشتباهات هوش مصنوعی عاملمحور میتواند بسیار پرهزینه باشد

سم آلتمن، مدیرعامل OpenAI، در گفتگویی در TED2025، به چالشهای آینده این فناوری پرداخت و اشاره کرد که هوش مصنوعی عاملمحور نوعی AI که میتواند خودکار و مستقل فعالیت کند، آیندهای محتمل اما پرریسک دارد. او گفت:

«فکر میکنم مردم در بسیاری از موارد بهآهستگی به هوش مصنوعی عاملمحور عادت خواهند کرد اما حتی اگر بعضیها با این فناوری راحت باشند و بعضیها نه، بالاخره وارد مرحلهای میشویم که سیستمهای هوش مصنوعی در اینترنت کلیک خواهند کرد. این یکی از جالبترین و پرپیامدترین چالشهای ایمنی است که با آن برخورد کردهایم، زیرا وقتی هوش مصنوعی به سیستمها و اطلاعات دسترسی پیدا کند و مرتکب اشتباه شود، اشتباهاتش ریسکهای بسیار بیشتری خواهد داشت.»

آلتمن تأکید کرد اگر کاربران به سیستمهای هوش مصنوعی اعتماد نداشته باشند، هیچگاه به آنها اجازه دسترسی به اطلاعات شخصی یا کنترل سیستمهای خود را نخواهند داد:

«محصول خوب، محصولی ایمن است. تا زمانی که مطمئن نباشید ایجنتهای [هوش مصنوعی] ما حساب بانکیتان را خالی نمیکند یا دادههایتان را حذف نمیکنند، از آنها استفاده نخواهید کرد.»

مایکروسافت در معرفی ابزار «Windows Recall» با مشکلات امنیتی بزرگی مواجه شد. این ابزار حتی زمانی که فیلتر اطلاعات حساس فعال بود، بازهم دادههای مهم مانند اطلاعات کارت بانکی را ثبت میکرد. این موضوع اعتماد عمومی را به سیستمهای هوش مصنوعی با دسترسی گسترده، به چالش کشید.

درمجموع، آینده هوش مصنوعی عاملمحور باوجود پتانسیلهای چشمگیر، همچنان با چالشهای جدی در زمینه امنیت و حریم خصوصی مواجه است. اظهارات سم آلتمن درباره دسترسی گسترده این سیستمها به اطلاعات شخصی مانند حسابهای بانکی، در کنار نمونههایی مانند ابزار جنجالی Windows Recall مایکروسافت، نشان میدهد جلب اعتماد کاربران نیازمند تضمینهای قوی امنیتی و شفافیت عملکردی است. اگرچه مسیر پیشرو برای این فناوری نوظهور روشن و پرشتاب به نظر میرسد، موفقیت آن به توانایی شرکتها در مدیریت ریسکها و ارتقای ایمنی سیستمها وابسته خواهد بود.

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- ورود هوش مصنوعی به اتاق تصمیم وزارت جهادکشاورزی؛ از تحلیل قوانین تا پایش نیروی انسانی

- «اوپنایآی» توسعهدهنده هوش مصنوعی جنجالبرانگیز «OpenClaw» را استخدام کرد

- ۹۵ درصد استارتآپها در جهان با شکست مواجه میشوند

- معرفی یک هوش مصنوعی برای مراسم عشای ربانی توسط واتیکان

- خرچنگ دریایی هوش مصنوعی آنقدرها هم هیجانانگیز نیست!

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت