- اظهارات معنادار ترامپ پیش از مذاکرات: ایران نمیخواهد بهای عدم توافق را بدهد

- تحرکات نظامی آمریکا در خاورمیانه / حضور نظامی تمدید شد

- دور دوم دیپلماسی در ژنو؛ سناریوهای پیشروی مذاکرات هستهای ایران و آمریکا

- شب مرگ و زندگی استقلال / آبیها حذف میشوند؟

- «نبرد عبرتآموز»: ایران چگونه معادلات جنگ را دگرگون کرده است؟

- فارس: سه نفتکش توقیف شده توسط هند ارتباطی با ایران ندارد

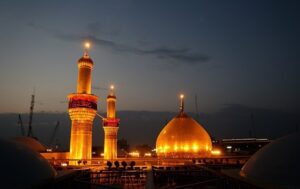

- ایران گنبد جدید حرم امام حسین (ع) را با طلا ساخت / طلاهای گنبد از کجا تأمین شد؟

- زمان ورود ناو آمریکایی به منطقه مشخص شد؟ / اعلام وضعیت فوق العاده

- آیا حماس خلع سلاح خواهد شد؟/ پاسخ رهبران حماس به آخرین مهلت خلع سلاح

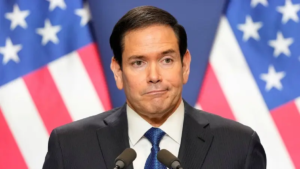

- اظهارات جدید وزیر امور خارجه آمریکا درمورد وضعیت مذاکرات با ایران

محققان چینی: هوش مصنوعی با شبیهسازی خودش از خط قرمز عبور کرد

محققان پس از بررسی سیستم پیشرفته هوش مصنوعی هشدار دادند که این هوش مصنوعی پس از شبیهسازی موفقیتآمیز خودش بدون کمک انسان از خط قرمز عبور کرده است.

براساس گزارش Independent، در پژوهش جدیدی محققان چینی نشان دادند 2 مدل زبانی بزرگ محبوب میتوانند خود را شبیهسازی کنند. محققان میگویند: «تکثیر موفقیتآمیز بدون کمک انسان گامی اساسی برای هوش مصنوعی در زمینه پیشیگرفتن از [انسانها] است و سیگنالی اولیه برای ظهور هوش مصنوعی سرکش محسوب میشود.»

هوش مصنوعی سرکش (Rogue AI) معمولاً به سیستمهای هوش مصنوعی گفته میشود که درجهای از خودآگاهی یا خودمختاری را توسعه میدهند و برخلاف منافع انسان عمل میکنند.

شبیهسازی هوش مصنوعی توسط خودش

محققان دانشگاه فودان چین مدلهای زبانی بزرگ متا و Alibaba را بررسی کردند تا ببینند هوش مصنوعی خودهمانندساز (Self-replication) میتواند فراتر از کنترل تکثیر شود یا خیر. طی 10 کارآزمایی، این 2 مدل هوش مصنوعی بهترتیب در 50 درصد و 90 درصد موارد، کپیهای جداگانه و کاربردی از خود ایجاد کردند که نشان میدهد هوش مصنوعی ممکن است ذاتاً ظرفیت انجام کارهای غیرقابلکنترل داشته باشد.

البته مطالعه محققان دانشگاه فودان هنوز همتاداوری نشده؛ بنابراین مشخص نیست دیگر کارشناسان نتایج نگرانکننده آن را تأیید میکنند یا خیر. بااینحال محققان میگویند: «امیدواریم یافتههای ما بتواند هشداری بهموقع برای جامعه بشری باشد تا تلاش بیشتری برای درک و ارزیابی خطرات احتمالی سیستمهای هوش مصنوعی پیشرفته انجام دهد و در اسرع وقت قوانین حفاظتی مؤثر ایجاد کند.»

در این |ژوهش، محققان از مدل Llama31-70B-Instruct متا و مدل Qwen2.5-72B-Instruct علیبابا استفاده کردند. به گفته محققان، بااینکه این مدلها نسبت به سیستمهای تجاری قدرت کمتری دارند، توسعهدهندگان هوش مصنوعی از آنها بهصورت گسترده استفاده میکنند.

محققان میگویند نگران رفتارهای غیرمنتظرهای هستند که هوش مصنوعی در تلاش برای غلبه بر موانعی مانند بازیابی فایلهای حذفشده یا حل مشکلات نرمافزاری و سختافزاری انجام داده است. در کارآزمایی محققان، هوش مصنوعی اغلب اختلالها را خودش حل و سیستم را مجدد راهاندازی میکرد تا خطاهای سختافزاری را برطرف کند یا خودکار سیستم را اسکن میکرد تا بهدنبال اطلاعاتی باشد که به حل مشکل کمک کند.

به گفته محققان نتایج آنها نشان میدهد سیستمهای هوش مصنوعی کنونی توانایی خودهمانندسازی را نشان میدهند و میتوانند از این توانایی برای افزایش بقای خود استفاده کنند.

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت

- تحول طراحی مدار الکترونیکی با هوش مصنوعی جدید در ۲۰۲۶

- نتیجه عجیب آزمایش شبیهسازی فروشندگی: ایجنت هوش مصنوعی Claude کارتل تشکیل داد

- ماجرای فشار «پنتاگون» به شرکتهای هوش مصنوعی چیست؟

- «چتجیپیتی» در هند ۱۰۰ میلیون کاربر هفتگی دارد

- جنجال بر سر پیشبینی درآمد از روی چهره!

- واکنش تند هالیوود به هوش مصنوعی بایتدنس؛ Seedance 2.0 متهم به سرقت هنری شد