- اظهارات معنادار ترامپ پیش از مذاکرات: ایران نمیخواهد بهای عدم توافق را بدهد

- تحرکات نظامی آمریکا در خاورمیانه / حضور نظامی تمدید شد

- دور دوم دیپلماسی در ژنو؛ سناریوهای پیشروی مذاکرات هستهای ایران و آمریکا

- شب مرگ و زندگی استقلال / آبیها حذف میشوند؟

- «نبرد عبرتآموز»: ایران چگونه معادلات جنگ را دگرگون کرده است؟

- فارس: سه نفتکش توقیف شده توسط هند ارتباطی با ایران ندارد

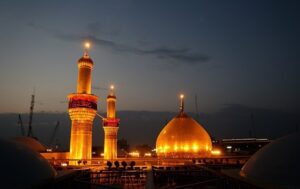

- ایران گنبد جدید حرم امام حسین (ع) را با طلا ساخت / طلاهای گنبد از کجا تأمین شد؟

- زمان ورود ناو آمریکایی به منطقه مشخص شد؟ / اعلام وضعیت فوق العاده

- آیا حماس خلع سلاح خواهد شد؟/ پاسخ رهبران حماس به آخرین مهلت خلع سلاح

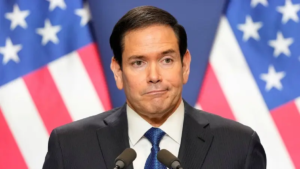

- اظهارات جدید وزیر امور خارجه آمریکا درمورد وضعیت مذاکرات با ایران

محققان نشان دادند: هوش مصنوعی میتواند شخصیت افراد را تقلید کند

پژوهشی جدید نشان داده مصاحبهای ۲ ساعته با هوش مصنوعی برای تقلید شخصیت افراد و آشنایی با علایق و ارزشهای آنها کفایت میکند.

طبق مقاله جدیدی که پژوهشگران دانشگاه استنفورد و بخش دیپمایند شرکت گوگل منتشر کردهاند، یک مدل هوش مصنوعی میتواند فقط طی ۲ ساعت، از شخصیت افراد الگوبرداری و تقلید کند. طی زمان گفتهشده، اطلاعات گوناگونی از فرد خواسته میشود که شامل خاطرات، افکار و نظرات درباره موضوعات مختلف است. برای چنین مدلی هوش مصنوعی مقلد نام برازندهای به نظر میرسد که در مقابل هوش مصنوعی مولد قرار میگیرد.

هزار نفر با سن، جنسیت، نژاد، سطح سواد و سوگیری سیاسی متفاوت در پژوهش اخیر که یکی از دانشجویان دکترای دانشگاه استنفورد آن را هدایت کرده است. به هر فرد ۱۰۰ دلار پرداخت شد تا با هوش مصنوعی مصاحبه کند و مدلی از شخصیت آنها ساخته شد. در ادامه مجموعهای از پرسشها و نظرسنجیها انجام شد تا هماهنگی مدل مجازی و شخصیت حقیقی فرد سنجیده شود. نتایج نشان میدهد هوش مصنوعی توانسته بهصورت میانگین تا ۸۵ درصد انتخابهای افراد را بهدرستی پیشبینی کند.

در این مقاله، عبارت «عوامل شبیهسازی» برای شخصیتهای مجازی مقلد استفاده شده است و میتوان از آنها برای آسانترکردن اموری مثل مطالعات اجتماعی و پژوهشهایی که استفاده از افراد حقیقی در آنها غیراخلاقی، گرانقیمت یا غیرعملی است، بهره گرفت. البته این دسته از مدلهای هوش مصنوعی با ابزارهای رایج فعلی کمی تفاوت دارند؛ زیرا هدف از خلق آنها آسانترکردن کارها و انجام سریعتر آنها برای کاربران نیست. چنین مدلهایی بهمنظور یادگیری الگوهای شخصیتی و تقلید از آنها ایجاد خواهند شد که احتمالاً میتوانند در آینده نزدیک برای پیشبینی رفتار کاربران در شبکههای اجتماعی هم استفاده شوند.

آیا هوش مصنوعی مقلد میتواند خطرناک باشد؟

بدون شک ساختن نسخه تقلیدشده از شخصیت افراد میتواند نگرانیهای متعددی پدید بیاورد؛ مخصوصاً اگر نسخههای مجازی بدون رضایت اشخاص و از روی دادههای آنها ساخته شود. چنین ابزارهایی میتوانند زمینه را برای ساخت محتوای جعلی و دیپفیک با شباهت بسیار نزدیک به نسخههای واقعی بسازند و موجی از اطلاعات و اخبار جعلی را در رسانهها منتشر کنند. ناگفته نماند تستهای استفادهشده برای بررسی شباهت هوش مصنوعی با شخصیت حقیقی افراد چندان پیچیده نبوده و از نمونههای رایج و ساده در علوم اجتماعی محسوب میشود؛ درنتیجه فعلاً جای نگرانی چندانی نیست.

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت

- تحول طراحی مدار الکترونیکی با هوش مصنوعی جدید در ۲۰۲۶

- نتیجه عجیب آزمایش شبیهسازی فروشندگی: ایجنت هوش مصنوعی Claude کارتل تشکیل داد

- ماجرای فشار «پنتاگون» به شرکتهای هوش مصنوعی چیست؟

- «چتجیپیتی» در هند ۱۰۰ میلیون کاربر هفتگی دارد

- جنجال بر سر پیشبینی درآمد از روی چهره!

- واکنش تند هالیوود به هوش مصنوعی بایتدنس؛ Seedance 2.0 متهم به سرقت هنری شد