- اظهارات معنادار ترامپ پیش از مذاکرات: ایران نمیخواهد بهای عدم توافق را بدهد

- تحرکات نظامی آمریکا در خاورمیانه / حضور نظامی تمدید شد

- دور دوم دیپلماسی در ژنو؛ سناریوهای پیشروی مذاکرات هستهای ایران و آمریکا

- شب مرگ و زندگی استقلال / آبیها حذف میشوند؟

- «نبرد عبرتآموز»: ایران چگونه معادلات جنگ را دگرگون کرده است؟

- فارس: سه نفتکش توقیف شده توسط هند ارتباطی با ایران ندارد

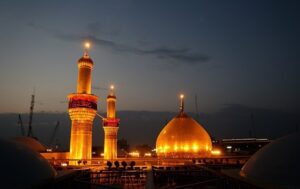

- ایران گنبد جدید حرم امام حسین (ع) را با طلا ساخت / طلاهای گنبد از کجا تأمین شد؟

- زمان ورود ناو آمریکایی به منطقه مشخص شد؟ / اعلام وضعیت فوق العاده

- آیا حماس خلع سلاح خواهد شد؟/ پاسخ رهبران حماس به آخرین مهلت خلع سلاح

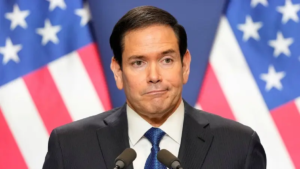

- اظهارات جدید وزیر امور خارجه آمریکا درمورد وضعیت مذاکرات با ایران

یکی از پدرخواندههای هوش مصنوعی به پروژهای برای جلوگیری از فجایع این فناوری پیوست

«یوشوا بنجیو» (Yoshua Bengio)، دانشمند کامپیوتر کانادایی که سال 2018 «جایزه تورینگ» را دریافت کرد و یکی از پدرخواندههای هوش مصنوعی مدرن محسوب میشود، به پروژهای پیوسته است که هدف آن بررسی امنیت مدلهای هوش مصنوعی و جلوگیری از وقوع فاجعه در اثر این فناوری است.

هدف پروژه مذکور که Safeguarded AI نام دارد، ساخت یک سیستم هوش مصنوعی است که میتواند امنیت سایر سیستمها را بررسی کند. «بنجیو» بهعنوان مدیر علمی به این برنامه اضافه شده است و توصیههای علمی برای آن ارائه خواهد کرد. این پروژه که طی چهار سال آینده 59 میلیون پوند بودجه دریافت خواهد کرد، توسط آژانس تحقیقات و اختراعات پیشرفته بریتانیا (ARIA) تأمین مالی میشود که سال گذشته میلادی برای سرمایهگذاری روی تحقیقات علمی بالقوه تحولآفرین شروع به کار کرد.

مدیر این پروژه میگوید که هدف Safeguarded AI ساخت سیستمهای هوش مصنوعی است که میتوانند در مورد تأثیر سایر مدلهای هوش مصنوعی بر دنیای واقعی، تضمینهای کمّی، مانند امتیاز ریسک ارائه کنند. همچنین در این فرایند از مدلهای علمی و اثباتهای ریاضی نیز کمک گرفته میشود.

او در ادامه میگوید که شرکتهای علم و فناوری راهی برای ارائه تضمینهای ریاضی مبنی بر اینکه سیستمهای هوش مصنوعی آنها طبق برنامه رفتار خواهند کرد، ندارند. او میگوید که غیرقابلاعتمادبودن مدلهای هوش مصنوعی از این نظر میتواند نتایج فاجعهباری بههمراه داشته باشد.

ارائه راهکارهای جدید برای ایمنسازی سیستمهای هوش مصنوعی

بنجیو و مدیر پروژه استدلال میکنند که تکنیکهای فعلی که برای کاهش خطر سیستمهای هوش مصنوعی پیشرفته در نظر گرفته میشود، مانند «تیم قرمز» که در آن افراد نقایص سیستمهای هوش مصنوعی را بررسی میکنند، محدودیتهای جدی بههمراه دارند و نمیتوان برای اطمینان از سیستمهای حیاتی به آنها اعتماد کرد.

در عوض، آنها امیدوار هستند تا این پروژه بتواند راههای جدیدی برای ایمنکردن سیستمهای هوش مصنوعی فراهم کند که کمتر به تلاشهای انسانی و بیشتر به ثبات ریاضی متکی هستند.

ARIA همچنین به سازمانها و افراد بخشهای پرخطر مانند حملونقل، مخابرات، زنجیره تأمین و تحقیقات پزشکی کمک مالی میکند تا برنامههایی را توسعه دهند که میتوانند از مکانیسمهای ایمنی هوش مصنوعی بهرهمند شوند. ARIA در مجموع 5.4 میلیون پوند در سال اول و 8.2 میلیون پوند دیگر در سال دوم به متقاضیان کمک مالی میکند.

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت

- تحول طراحی مدار الکترونیکی با هوش مصنوعی جدید در ۲۰۲۶

- نتیجه عجیب آزمایش شبیهسازی فروشندگی: ایجنت هوش مصنوعی Claude کارتل تشکیل داد

- ماجرای فشار «پنتاگون» به شرکتهای هوش مصنوعی چیست؟

- «چتجیپیتی» در هند ۱۰۰ میلیون کاربر هفتگی دارد

- جنجال بر سر پیشبینی درآمد از روی چهره!

- واکنش تند هالیوود به هوش مصنوعی بایتدنس؛ Seedance 2.0 متهم به سرقت هنری شد