- افشاگری یک مستندساز از بحران پسماند در شمال کشور/ تهدید به مرگ شدم!

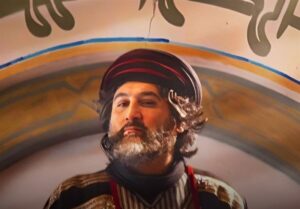

- عکسی از سریال جدید محمدحسین لطیفی/«خسوف» برای محرم آماده میشود

- کنداکتور شبکه نسیم به احترام خانوادههای شهدای دیماه تغییر کرد

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- قالیباف: ایران یکپارچه سوگوار مراسم چهلم فرزندان دلبند شهید خود است

- میزان تسهیلات ازدواج و فرزندآوری تعیین شد

- پزشکیان: نباید اجازه دهیم سلامت پلیس در ماموریتها به خطر بیفتد

- در مواجهه با اخبار آکسیوس هوشیار باشیم

- مجوز مجلس برای بهکارگیری ۱۰ هزار معلم بازنشسته و حقالتدریس

- حجتالاسلام سیدمحمدجواد جلالی دبیر هیئت اجرایی شورای وحدت شد

OpenAI ظاهراً تیم بررسی خطرات هوش مصنوعی را منحل کرده است

منابع آگاه گزارش دادهاند که OpenAI تیمی را که روی خطرات بلندمدت هوش مصنوعی متمرکز بوده، منحل کرده است. این خبر درحالی منتشر میشود که چند روز قبل «ایلیا سوتسکیور»، همبنیانگذار OpenAI از این شرکت جدا شد و اکنون نیز یان لیکه (Jan Leike)، یکی از محققان کلیدی این شرکت خبر استعفای خود را اعلام کرده است.

براساس گزارش منابع آگاه CNBC، شرکت OpenAI تیمی موسوم به «Superalignment» را که برای رسیدگی به خطرات درازمدت هوش مصنوعی اختصاص داده شده بود، منحل کرده است. یان لیکه این تیم را اداره میکرد. این تیم در سال 2023 بهمنظور حل مسائل فنی در اجرای پروتکلهای ایمنی تشکیل شد.

یان لیکه دراینباره میگوید:

«طی سالهای گذشته، فرهنگ و فرایند ایمنیسازی [هوش مصنوعی] جای خود را به محصولات پرزرقوبرق داده است.»

انحلال تیم ایمنی هوش مصنوعی OpenAI

تیم Superalignment شرکت OpenAI که در سال 2023 ایجاد شد، برای دستیابی به پیشرفتهای علمی و فنی برای هدایت و کنترل سیستمهای هوش مصنوعیِ بسیار هوشمندتر از انسان فعالیت کرده است. در آن زمان، OpenAI گفته بود که 20 درصد از قدرت محاسباتی خود را در طول چهار سال به فعالیتهای این تیم اختصاص خواهد داد.

اکنون به گزارش منبعی آگاه، پس از حدود یک سال OpenAI این تیم را منحل کرده است و برخی از اعضای آن به چندین تیم دیگر در شرکت منتقل شدند.

ایلیا سوتسکیور و یان لیکه خروج خود از OpenAI را به فاصله کوتاهی از یکدیگر اعلام کردند، اما بهتازگی لیکه جزئیات بیشتری را درباره دلیل ترک این استارتاپ بهاشتراک گذاشته است. او در پستی در ایکس گفت: «من به این تیم پیوستم زیرا فکر میکردم OpenAI بهترین مکان در جهان برای انجام تحقیقات [درباره ایمنی هوش مصنوعی] است.» بااینحال او میگوید که در چند ماه گذشته تیم او برخلاف جریان اصلی شرکت بوده و انجام تحقیقات حیاتی در حوزه ایمنی پیوسته سختتر شده است.

او میگوید:

«ساخت ماشینهای هوشمندتر از انسان، ذاتاً یک فرایند خطرناک است. OpenAI مسئولیت بزرگی از طرف تمام بشریت برعهده دارد.»

OpenAI هفته گذشته از جدیدترین مدل هوش مصنوعی خود رونمایی کرد که قابلیتهای درک صوت و تصویر آن خیرهکننده است. بااینحال برخی افراد مانند «ایلان ماسک»، مدیرعامل تسلا چندان نظر مساعدی به این مدل نداشتهاند.

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- ورود هوش مصنوعی به اتاق تصمیم وزارت جهادکشاورزی؛ از تحلیل قوانین تا پایش نیروی انسانی

- «اوپنایآی» توسعهدهنده هوش مصنوعی جنجالبرانگیز «OpenClaw» را استخدام کرد

- ۹۵ درصد استارتآپها در جهان با شکست مواجه میشوند

- معرفی یک هوش مصنوعی برای مراسم عشای ربانی توسط واتیکان

- خرچنگ دریایی هوش مصنوعی آنقدرها هم هیجانانگیز نیست!

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت