- فارس: سه نفتکش توقیف شده توسط هند ارتباطی با ایران ندارد

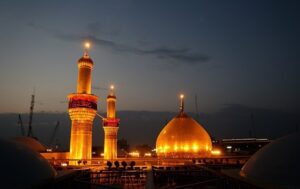

- ایران گنبد جدید حرم امام حسین (ع) را با طلا ساخت / طلاهای گنبد از کجا تأمین شد؟

- زمان ورود ناو آمریکایی به منطقه مشخص شد؟ / اعلام وضعیت فوق العاده

- آیا حماس خلع سلاح خواهد شد؟/ پاسخ رهبران حماس به آخرین مهلت خلع سلاح

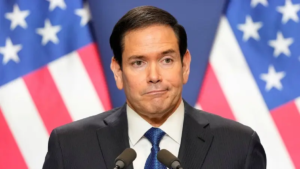

- اظهارات جدید وزیر امور خارجه آمریکا درمورد وضعیت مذاکرات با ایران

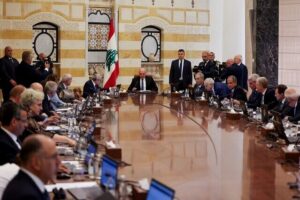

- تصمیم جدید دولت لبنان درمورد خلع سلاح حزب الله

- فوری/ جنگ اوکراین متوقف میشود؛ موافقت زلنسکی با پیشنهاد آتشبس

- واکنش سوئیس به نقش عمان در گفتوگو میان آمریکا و ایران

- رسوایی مالی تازه در استقلال/ پشتپرده پرداخت وام ۴۷ میلیاردی به رامین رضاییان چیست؟

- اینفانتینو لبنانی شد/ رئیس فیفا سومین تابعیتش را گرفت

اپل در تحقیقی انتظارات کاربران از عاملهای هوش مصنوعی را بررسی کرد

تیمی از پژوهشگران اپل به بررسی انتظارات کاربران واقعی از عاملهای هوش مصنوعی و نحوه تعامل آنها با این سیستمها پرداختهاند.

در مطالعهای با عنوان Mapping the Design Space of User Experience for Computer Use Agents، آنها دریافتند که با وجود سرمایهگذاریهای گسترده در توسعه و ارزیابی عاملهای هوش مصنوعی، بسیاری از جنبههای تجربه کاربری، از جمله نحوه تعامل کاربران و طراحی رابطها، کمتر مورد توجه قرار گرفته است. این تحقیق در دو مرحله انجام شد: ابتدا پژوهشگران الگوها و ملاحظات اصلی UX عاملهای موجود را شناسایی کردند و سپس با روش عملی Wizard of Oz این الگوها را در تعامل واقعی با کاربران آزمایش و بهینهسازی کردند.

تعامل کاربران با عاملهای هوش مصنوعی

طبق گزارشها، در مرحله نخست، نه عامل دسکتاپ، موبایل و وب شامل Claude Computer Use Tool ،Adept ،OpenAI Operator ،AIlice ،Magentic-UI ،UI-TARS ،Project Mariner ،TaxyAI و AutoGLM بررسی شدند. سپس با همکاری هشت متخصص در حوزه UX و AI، یک طبقهبندی جامع ایجاد شد که شامل چهار دسته اصلی، 21 زیرمجموعه و 55 ویژگی نمونه بود. چهار دسته اصلی عبارت بودند از ورودی کاربران، شفافیت اقدامات عامل، کنترل کاربران و مدل ذهنی و انتظارات، که از نحوه ارائه برنامهها و توانمندیهای عامل تا مدیریت خطاها و امکان دخالت کاربران را پوشش میداد.

در مرحله دوم، 20 کاربر با تجربه قبلی در تعامل با عاملهای هوش مصنوعی، در آزمایش Wizard of Oz شرکت کردند. کاربران از طریق رابط گفتوگو وظایف رزرو تعطیلات یا خرید آنلاین را به عامل واگذار میکردند، در حالی که پژوهشگر در اتاقی دیگر نقش عامل را با کنترل صفحه و کیبورد شبیهسازی میکرد. کاربران میتوانستند دستورهای متنی وارد کرده و با دکمه توقف عملکرد عامل را متوقف کنند. برخی وظایف عمداً با خطا یا تداخل انجام شد تا واکنش کاربران بررسی شود و پژوهشگران رفتار و انتظارات آنها را تحلیل کنند.

نتایج نشان داد کاربران خواهان دیدن عملکرد عاملها هستند، اما نمیخواهند هر مرحله را کنترل کنند. رفتار عامل باید متناسب با نوع فعالیت و آشنایی کاربر با رابط تغییر کند؛ کاربران تازهکار به شفافیت، توضیح مراحل و تأییدیههای موقت نیاز بیشتری دارند، به ویژه زمانی که اقدامات پیامد واقعی دارند مانند خرید یا تغییر اطلاعات حساب. اعتماد کاربران سریعاً در مواجهه با خطاها یا فرضیات پنهان از بین میرود و آنها ترجیح میدهند عامل در شرایط مبهم یا انحراف از برنامه، توقف کرده و برای تأیید اقدام کند.

این مطالعه چارچوبی کاربردی برای توسعهدهندگان اپلیکیشن ارائه میدهد تا عاملهای هوش مصنوعی را به گونهای طراحی کنند که شفاف، قابل اعتماد و هماهنگ با نوع فعالیت و سطح تجربه کاربری کاربران باشد، و تعامل با آن برای کاربران طبیعی و مؤثر باشد.

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت

- تحول طراحی مدار الکترونیکی با هوش مصنوعی جدید در ۲۰۲۶

- نتیجه عجیب آزمایش شبیهسازی فروشندگی: ایجنت هوش مصنوعی Claude کارتل تشکیل داد

- ماجرای فشار «پنتاگون» به شرکتهای هوش مصنوعی چیست؟

- «چتجیپیتی» در هند ۱۰۰ میلیون کاربر هفتگی دارد

- جنجال بر سر پیشبینی درآمد از روی چهره!

- واکنش تند هالیوود به هوش مصنوعی بایتدنس؛ Seedance 2.0 متهم به سرقت هنری شد