- افشاگری یک مستندساز از بحران پسماند در شمال کشور/ تهدید به مرگ شدم!

- عکسی از سریال جدید محمدحسین لطیفی/«خسوف» برای محرم آماده میشود

- کنداکتور شبکه نسیم به احترام خانوادههای شهدای دیماه تغییر کرد

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- قالیباف: ایران یکپارچه سوگوار مراسم چهلم فرزندان دلبند شهید خود است

- میزان تسهیلات ازدواج و فرزندآوری تعیین شد

- پزشکیان: نباید اجازه دهیم سلامت پلیس در ماموریتها به خطر بیفتد

- در مواجهه با اخبار آکسیوس هوشیار باشیم

- مجوز مجلس برای بهکارگیری ۱۰ هزار معلم بازنشسته و حقالتدریس

- حجتالاسلام سیدمحمدجواد جلالی دبیر هیئت اجرایی شورای وحدت شد

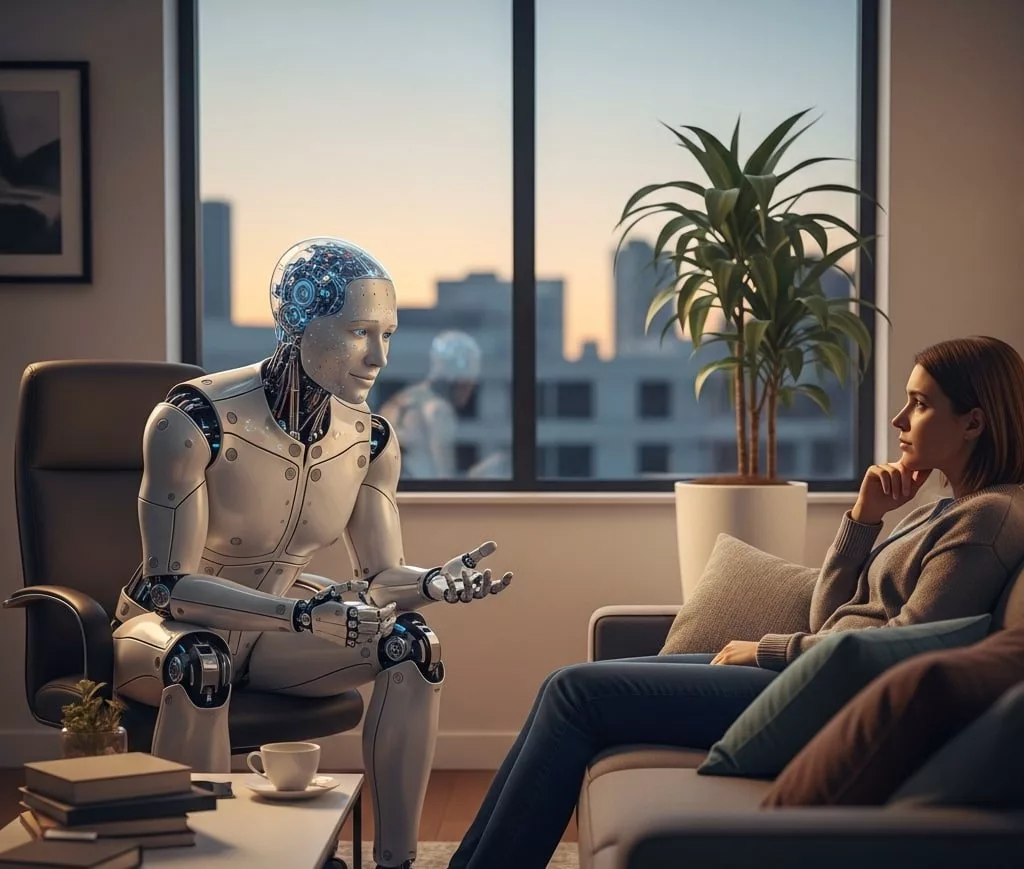

خطر افشای اطلاعات بیماران؛ برخی تراپیستها مخفیانه از ChatGPT استفاده میکنند

گزارش جدیدی نشان میدهد که برخی تراپیستها یا درمانگران بهطور پنهانی از ChatGPT در جلسات درمانی خود استفاده میکنند. این کار میتواند حریم خصوصی مراجعان را در معرض خطر قرار دهد.

در سالهای اخیر هوش مصنوعی به ابزار کمکی برای حوزههای مختلف تبدیل شده، اما ورود آن به حوزه رواندرمانی بحثبرانگیز بوده است. براساس گزارشی از MIT Technology Review، برخی درمانگران بهطور مخفیانه در طول جلسات از ChatGPT برای تولید پاسخ یا یافتن راهحلهای سریع استفاده میکنند.

در این گزارش به یک فرد آمریکایی با نام «دکلن» اشاره شده که بهطور ناخواسته متوجه شده درمانگرش حرفهای او را مستقیماً در ChatGPT وارد میکند و سپس پاسخهای هوش مصنوعی را در اختیار او قرار میدهد. فرد دیگری با نام «هوپ» که پس از مرگ سگش به درمانگر مراجعه کرده، پیغامی از او دریافت کرده که در بالای آن نوشته شده «نسخهای انسانیتر و صمیمانهتر با لحن محاورهای.»

هشدار کارشناسان درباره استفاده تراپیستها از ChatGPT برای درمان

به گفته کارشناسان این موضوع میتواند اعتماد بیمار را بهشدت تحت تأثیر قرار دهد؛ زیرا بسیاری از بیماران انتظار دارند که گفتههای آنها خصوصی باشد.

«توماس وستنهولز»، درمانگر روابط فردی و زوجها، در گفتگو با Cybernews تأکید میکند که شفافیت در این زمینه اهمیت زیادی دارد. او میگوید:

«درمان براساس صداقت و شفافیت شکل میگیرد. اگر مراجعهکننده متوجه شود درمانگرش بدون اطلاع او از ChatGPT کمک گرفته، این موضوع میتواند پیوند اعتماد میان آنها را از بین ببرد.»

به گفته او، نقش هوش مصنوعی میتواند در امور اداری یا تهیه منابع آموزشی مفید باشد، اما هرگز نباید در روند درمان جایگزین نیروی انسانی شود.

هرچند برخی مطالعات نشان میدهند که پاسخهای تولیدشده توسط هوش مصنوعی ممکن است از دید بیماران مناسبتر به نظر برسند، اما مشکل اصلی به عدم اطلاعرسانی صحیح به آنها مربوط میشود. بیماران معمولاً در آغاز درمان توافقی مبنی بر محرمانه بودن دادههای خود را امضا میکنند و اگر بعدها متوجه شوند اطلاعاتشان به یک مدل زبانی داده شده، ممکن است احساس آسیبپذیری بیشتری کنند.

وستنهولز توضیح میدهد:

«شفافیت غیرقابل مذاکره است. در رواندرمانی مبتنی بر EFT، ما میدانیم که روند بهبودی تنها در روابطی شکل میگیرد که فرد احساس امنیت کند، و این امنیت به صداقت وابسته است. اگر قرار است هوش مصنوعی بخشی از روند درمان باشد، بیماران باید بدانند و رضایت دهند.»

- پارلمان اروپا استفاده از هوش مصنوعی روی دستگاههای سازمانی را ممنوع کرد

- ورود هوش مصنوعی به اتاق تصمیم وزارت جهادکشاورزی؛ از تحلیل قوانین تا پایش نیروی انسانی

- «اوپنایآی» توسعهدهنده هوش مصنوعی جنجالبرانگیز «OpenClaw» را استخدام کرد

- ۹۵ درصد استارتآپها در جهان با شکست مواجه میشوند

- معرفی یک هوش مصنوعی برای مراسم عشای ربانی توسط واتیکان

- خرچنگ دریایی هوش مصنوعی آنقدرها هم هیجانانگیز نیست!

- هشدار محققان: باتها در شبکههای اجتماعی میتوانند افکار عمومی را فریب دهند

- عقبنشینی بایتدنس در پی اعتراض هالیوود؛ هوش مصنوعی Seedance 2.0 محدود میشود

- مدیرعامل گوگل و OpenAI برای شرکت در اجلاس هوش مصنوعی به هند میروند

- تنش میان پنتاگون و آنتروپیک بر سر استفاده نظامی از هوش مصنوعی بالا گرفت